.png)

IA no espaço: combinando aprendizado de máquina com imagens de satélite para impulsionar a agricultura

Introdução

Na área de pesquisa agrícola, utilizar o poder das imagens de satélite se tornou um divisor de águas. Essas tecnologias fornecem informações valiosas que permitem que agricultores, pesquisadores e profissionais do setor tomem decisões informadas, otimizem recursos e maximizem o rendimento das safras. No entanto, trabalhar com dados de satélite tem seu próprio conjunto de desafios e complexidades que devemos enfrentar com cuidado. Além disso, todos nós testemunhamos como, nos últimos anos, a IA dominou o mundo. Estamos, sem dúvida, em um momento de mudança. Todos os dias, vemos mais e mais aplicações de aprendizado de máquina em todos os tipos de campos. Então, inevitavelmente, isso levanta a questão: e se combinássemos o aprendizado de máquina com imagens de satélite? Neste blog, exploramos o mundo das imagens de satélite na agricultura e como incorporar o aprendizado de máquina no processo. Vamos nos concentrar nas complexidades da preparação de dados, nos modelos utilizados e nas possíveis aplicações. Aprenderemos sobre os detalhes do uso de imagens de satélite para analisar plantações, classificá-las e estimar a densidade da vegetação para ajudar os agricultores a aumentar sua produtividade!

Exemplos de casos de uso

A principal pergunta que pode vir à mente é: “Como podemos usar imagens de satélite na agricultura?” Bem, existem muitos exemplos. Talvez um dos casos de uso mais comuns seja identificar os tipos de culturas em uma região de interesse. No entanto, a pesquisa atual abriu muitas novas possibilidades. Agora, examinaremos muitos exemplos, focando especialmente em como esses aplicativos podem aumentar a produtividade:

Classificação e segmentação de culturas:

Imagine ser capaz de identificar, encontrar e estimar o tamanho de diferentes tipos de culturas em uma região de interesse, usando apenas uma única imagem de satélite da região desejada! Uma das abordagens mais comuns para isso consiste na aplicação de modelos de segmentação semântica (como o Meta Segmente qualquer coisa6) em cada foto. Essa abordagem faz um ótimo trabalho como primeira tentativa, embora possamos precisar de modelos maiores e mais complexos para obter uma precisão de última geração. Também podemos usá-lo para identificar as principais características geográficas, como corpos d'água ou regiões áridas. Esse é, de longe, o aplicativo mais comum.

Rastreamento do ciclo da colheita:

Uma característica importante das imagens de satélite é que elas podem fornecer informações sobre a vegetação de uma região específica. Isso é possível graças aos sensores ópticos especializados que podem capturar informações que não podem ser vistas a olho nu. Entraremos em detalhes mais detalhados neste blog. Por enquanto, lembre-se de que, ao usar essas informações, é possível acompanhar a saúde das lavouras para otimizar as práticas agrícolas.

Previsão do rendimento da safra:

Que tipo de informação podemos obter se estudarmos uma região por um período específico de tempo? Ao analisar várias imagens tiradas em um amplo período de tempo, é possível estimar o rendimento da safra para uma melhor tomada de decisão e planejamento da colheita!

Análise do estado fenológico da cultura:

Por fim, uma das práticas mais comuns na agricultura é a fenotipagem, que geralmente é demorada e trabalhosa. É possível monitorar os estados fenológicos das culturas com imagens de satélite, analisando várias características, como floração e maturação. É possível obter informações sobre esses aspectos a partir de dados multiespectrais. Isso concede ao agricultor muitas informações para uma melhor tomada de decisão.

Entendendo os dados de satélite

Agora vimos por que as imagens de satélite podem ser úteis na agricultura. Agora, para ver como isso pode nos ajudar, precisamos primeiro entender os dados que ele pode nos fornecer.

Imagens multiespectrais:

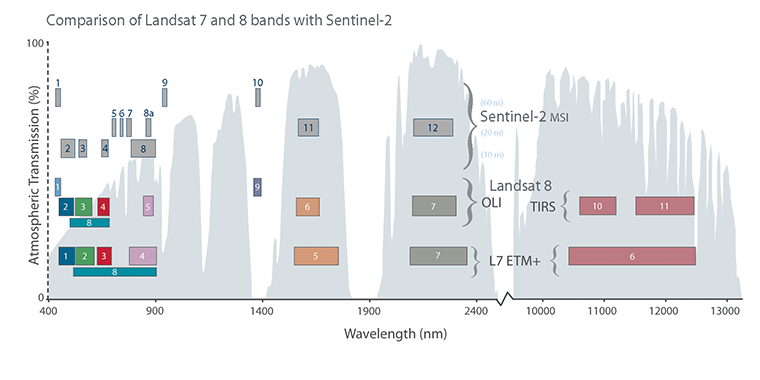

Atualmente, existem muitos tipos de satélites em órbita, cada um com uma ampla gama de sensores que fornecem diferentes tipos de informações. O tipo mais comum de dados que os satélites fornecem consiste em imagens coloridas da superfície terrestre, obtidas por sensores ópticos que capturam a luz visível. Embora isso certamente possa ser útil, também podemos obter informações adicionais se analisarmos outras partes do espectro eletromagnético, como o infravermelho. É aí que entra o conceito de “imagens multiespectrais”. Imagens multiespectrais são feitas coletando luz de diferentes faixas de frequências. Ao contrário das imagens RGB comuns, que têm apenas três canais de cores (vermelho, verde e azul), as imagens multiespectrais têm muitos canais, cada um mostrando uma banda de frequência diferente. Podemos ver como diferentes canais são distribuídos em diferentes partes do espectro na figura 1. [caption id="attachment_3279" align="aligncenter” width="760"]

Figura 1: distribuição dos canais de imagem em todo o espectro eletromagnético para vários satélites, como o Sentinel 2. (Fonte: centro EROS, Serviço Geológico dos EUA 8) [/legenda]

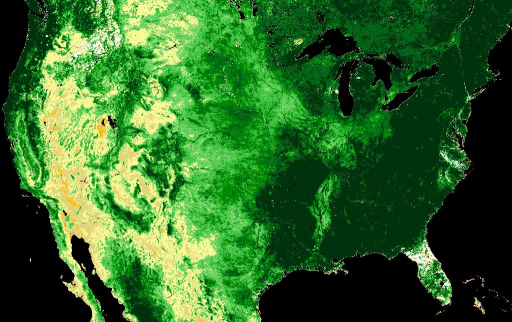

Índice de vegetação (VI) e temperatura da superfície terrestre (LST):

Muitos satélites também são capazes de medir a temperatura da superfície terrestre (LST) de uma área. Ou seja, a temperatura da superfície terrestre, ignorando a influência atmosférica, como vento, umidade, etc. Isso pode ser muito útil em várias culturas e também pode nos ajudar a encontrar regiões ideais para a agricultura. Mas talvez uma das ferramentas mais poderosas que os satélites possam nos fornecer seja a capacidade de calcular um índice de vegetação (VI). Esse índice é obtido pela análise dos componentes da luz vermelha e infravermelha e pode indicar a presença de vegetação em uma área. Existem muitas variações desse índice, sendo o NDVI o mais conhecido. Dependendo do nosso caso de uso, podemos optar por implementações diferentes dessa métrica. Mas o conceito-chave continua o mesmo: medir a presença de vegetação em uma região de interesse. [caption id="attachment_3281" align="aligncenter” width="512"]

Figura 2: exemplo de imagem NDVI. Obtido do EarthExplorer, U.S. Geological Survey 9[/legenda]

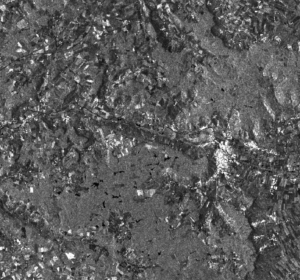

Radares de abertura sintética (SARs):

Como você já deve ter notado, as imagens dos satélites são realmente poderosas. Vimos como podemos usá-lo para medir a temperatura ou a densidade da vegetação, o que mostra quantos dados podemos obter! Infelizmente, todas essas fontes de dados compartilham a mesma limitação: elas são obtidas de fontes ópticas. Esses sensores funcionam capturando a luz do sol refletida na superfície da Terra. Por causa disso, existem muitos fatores externos que podem afetar os dados recebidos, como o clima e outras condições atmosféricas imprevisíveis. Como alternativa, a maioria dos satélites também conta com radares de abertura sintética ou SARs. Os radares funcionam transmitindo ondas de rádio em direção a um objetivo (neste caso, a superfície da Terra) e estimando a distância com base no tempo que leva para o pulso refletido voltar. Os radares podem ser usados para mapear a superfície da Terra gerando uma imagem de “nuvem de pontos”. Os SARs são um tipo especial de radar que aproveita o movimento do satélite enquanto ele orbita a Terra para melhorar a qualidade da imagem. Ao contrário da luz visível, as ondas de rádio podem passar livremente pela atmosfera terrestre, o que torna as imagens SAR imunes às condições climáticas. Além disso, como não é necessária luz solar, os SARs podem ser usados a qualquer hora, mesmo à noite! Embora tudo isso pareça uma ótima notícia, é importante observar que, diferentemente das imagens tradicionais, os dados SAR consistem em apenas um canal, e é por isso que a maioria dos exemplos consiste em imagens em tons de cinza. Isso significa que temos menos dados com os quais trabalhar. Um exemplo de imagem SAR é mostrado na figura 3:

[caption id="attachment_3295" align="aligncenter” width="300"]

Figura 3: Exemplo de imagem SAR obtida do Sentinel-1 (baixada da plataforma Copernicus 10) [/legenda]

Fontes de dados

Um dos aspectos mais importantes de qualquer projeto de IA é saber onde podemos obter dados para nossos modelos. Atualmente, graças ao esforço de várias agências de todo o mundo, as imagens de satélite estão mais acessíveis do que nunca. Agora, examinaremos alguns projetos que fornecem acesso fácil a diferentes tipos de dados de satélite:

- A Agência Espacial Europeia lançou a missão “Sentinel-2”, que consiste em 2 satélites que capturam imagens multiespectrais de diferentes partes do globo. Essas imagens estão disponíveis publicamente por meio do Plataforma Copernicus10 sob uma licença Creative Commons CC BY-SA 3.0 IGO.

- O Explorador da Terra9 A plataforma foi desenvolvida pelo Serviço Geológico dos EUA e fornece imagens de uma grande variedade de missões, como a Landsat da NASA. Essas informações são gratuitas e consistem principalmente em imagens RGB, embora outros tipos de dados possam ser encontrados.

- O Instituto Nacional de Pesquisas Espaciais do Brasil, em colaboração com a China, lançou um catálogo de imagens de satélite da América do Sul e África11. Semelhante aos casos anteriores, essas informações estão disponíveis gratuitamente, sob a Licença Internacional Creative Commons Attribution-ShareAlike 4.0.

Como podemos ver, existem muitas opções para extrair dados para nossos projetos. Todos esses esforços também permitiram que muitas organizações desenvolvessem seus próprios conjuntos de dados. Alguns dos quais também estão disponíveis publicamente. Conjuntos de dados como EuroSat15, AgriFieldNet12 e o Big Earth Net13 A benchmark fornece rótulos para classificação e segmentação de culturas, com base em imagens RGB e multiespectrais. Agora, vimos muitas maneiras pelas quais as imagens de satélite podem ser usadas para melhorar a produtividade agrícola aprimorada com o aprendizado de máquina. Também vimos o que os satélites de dados podem nos fornecer e como acessá-los. Agora, usaremos tudo o que aprendemos até agora em alguns experimentos para mostrar o poder dessas tecnologias!

Exemplos práticos

Já discutimos muitas aplicações dessas tecnologias na agricultura. No entanto, analisar todos esses casos exigiria mais do que uma única postagem no blog! Agora vamos nos concentrar em dois exemplos principais: classificação e segmentação de culturas, já que são os mais comuns.

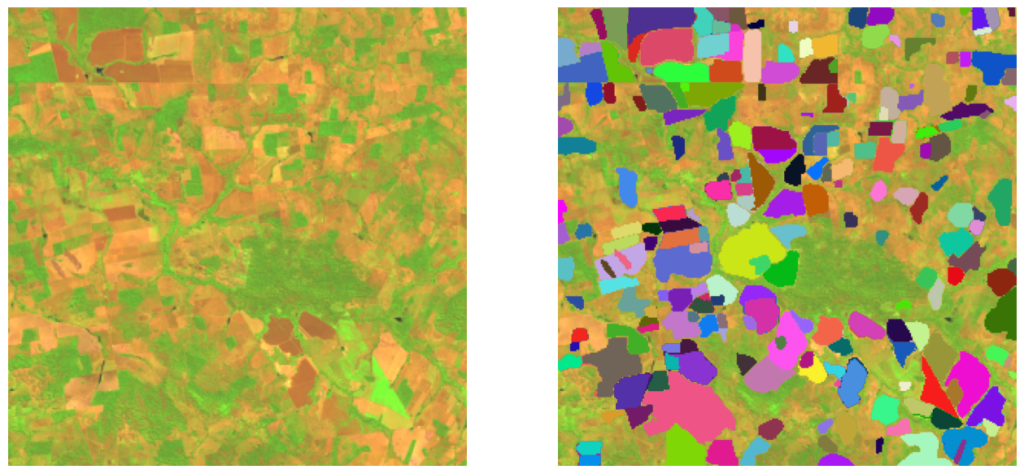

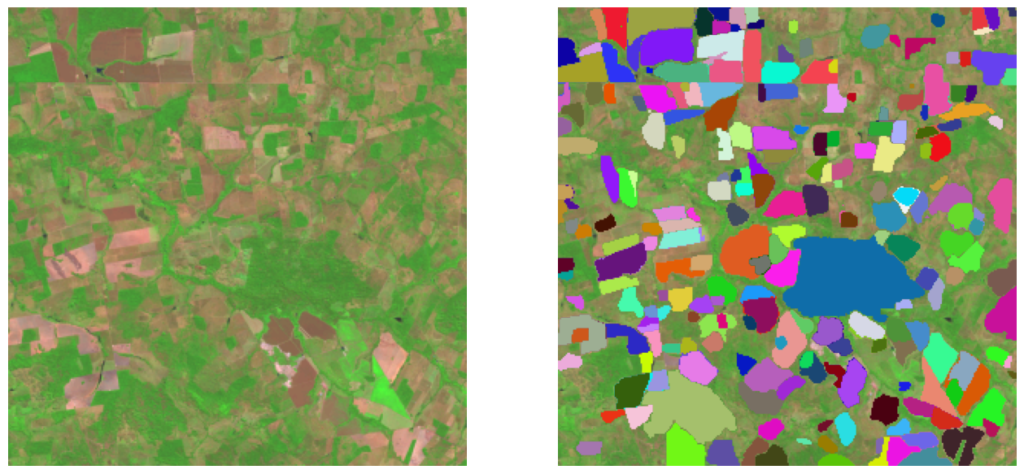

Segmentação de culturas usando um modelo de segmentação zero

Agora veremos um exemplo simples em que usaremos uma rede de segmentação em uma série de imagens de satélite obtidas da missão Sentinel-2 para localizar vários gráficos e outras características importantes em uma região específica. Usaremos o Segmente qualquer coisa6 modelo (SAM) como a rede de segmentação para esses experimentos. É importante observar que estamos realizando esse teste com um modelo de disparo zero, o que significa que nosso modelo ainda não foi treinado com imagens de satélite para esse propósito específico. As imagens usadas nesta demonstração foram obtidas da missão Sentinel-2, por meio da plataforma Copernicus. Como essas são imagens multiespectrais compostas por 12 canais e o SAM só pode funcionar com imagens RGB normais, teremos que escolher 3 bandas da imagem baixada para criar um “composto RGB” que possa ser alimentado na rede. Para nosso primeiro experimento, escolheremos as bandas B-04, B-03 e B-02, pois elas correspondem à luz vermelha, verde e azul no espectro, respectivamente. Podemos ver um exemplo dessa imagem na figura 4: [caption id="attachment_3284" align="aligncenter” width="300"]

Figura 4: exemplo de uma imagem de satélite RGB. Obtido do EartExplorer, U.S. Geological Survey 9[/caption] Agora usaremos o modelo vit-H do SAM para obter uma máscara de segmentação na imagem fornecida. Lembre-se de que, embora isso nos permita determinar a localização e o tamanho das safras e outras características importantes, ele não identifica cada tipo de cultura. Para conseguir isso, teremos que treinar nossa rede para realizar também a classificação. Depois de processarmos a imagem por meio da rede de segmentação, obtemos uma máscara como esta: [caption id="attachment_3286" align="aligncenter” width="512"]

Figura 5: imagem de satélite original (esquerda) versus saída de segmentação (direita) [/caption]

Como podemos ver, a rede é capaz de identificar e segmentar diferentes culturas na imagem, embora não consiga distinguir cada tipo de corte por enquanto. Poderíamos usar essas informações para acompanhar a distribuição das safras em uma região específica, o que pode ser útil para analisar as terras agrícolas disponíveis. Lembre-se de que isso foi feito com um modelo zero, imagine o que poderíamos alcançar com mais treinamento!

Combinando diferentes bandas espectrais

Agora, usamos apenas 3 das 12 bandas espectrais disponíveis. Que tipo de informação poderíamos obter dos demais canais? Como vimos anteriormente, o SAM só pode processar imagens com 3 canais, então uma solução alternativa normal é criar outras combinações usando diferentes bandas espectrais. Podemos encontrar muitas combinações no Repositório Sentinel-hub16, adequado para várias aplicações. Essas combinações são chamadas de “compostos RGB”. Por exemplo, o composto de “cor falsa”, que consiste nas bandas B08, B04 e B03, é comumente usado para acessar a densidade e a saúde das plantas. Além disso, um composto de “infravermelho de onda curta”, que usa as bandas B12, B08 e B04, pode fornecer uma ótima visão da quantidade de água presente nas plantas e no solo, o que pode ser útil para detectar danos causados pelo fogo. Podemos experimentar esses compostos combinando outras bandas e alimentando a imagem resultante por meio da rede de segmentação para ver quais resultados obtemos. Para esta prova de conceito, usamos principalmente 3 compostos RGB. Cada um deles, assim como os resultados obtidos, são mostrados abaixo: [caption id="attachment_3287" align="aligncenter” width="512"]

Figura 6a: Resultados da segmentação para as bandas B11, B8 e B2 [/caption] [caption id="attachment_3289" align="aligncenter” width="512"]

Figura 6b: Resultados da segmentação para as bandas B12, B8 e B4 [/caption] [caption id="attachment_3290" align="aligncenter” width="512"]

Figura 6c: Resultados da segmentação para as bandas B11, B8A e B4 [/caption] Podemos ver que as máscaras obtidas diferem dependendo do composto RGB usado. Isso mostra como cada uma dessas bandas contém informações diferentes que podem ser interpretadas de forma diferente pelo nosso modelo. Para algumas aplicações, usar um desses compostos pode ser suficiente. No entanto, ainda há muitas informações que podemos usar. Nossos próximos passos seriam experimentar essas bandas espectrais, tentando combinações diferentes e adicionando diferentes técnicas de processamento para ver se podemos melhorar os resultados. Também podemos tentar com diferentes modelos de segmentação ou até mesmo treinar nosso próprio modelo personalizado. Como podemos ver, existem muitas possibilidades, o mundo das imagens de satélite é realmente poderoso!

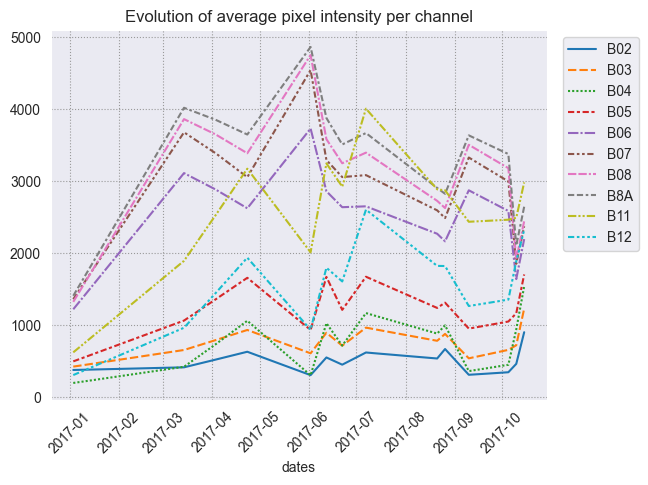

Classificação de recortes com séries temporais de imagens de satélite

Como vimos antes, a classificação de culturas é um dos casos de uso mais comuns. No entanto, diferentemente do nosso exemplo anterior, geralmente é uma tarefa muito mais complicada. Isso ocorre porque a luz refletida pelas plantações geralmente varia com o tempo, o que torna a classificação muito mais difícil com apenas uma única imagem. Como alternativa, muitas propostas de última geração geralmente envolvem o uso de séries temporais de imagens de satélite. Ao ter várias fotos do mesmo corte em um período específico, podemos ver como a refletância da luz evolui. Podemos usar essas informações para determinar o tipo de cultura, pois diferentes culturas geralmente têm diferentes refletâncias de luz. Para demonstrar isso, podemos ver um exemplo da variação da refletância de luz das safras de colza de inverno ao longo do tempo em diferentes bandas espectrais no gráfico a seguir: [caption id="attachment_3291" align="aligncenter” width="648"]

Figura 7: evolução da intensidade média de pixels por banda espectral (canal de imagem) para a colza de inverno. Dados obtidos em 24 datas diferentes, de janeiro de 2017 a outubro do mesmo ano.

Fonte: Garnot, Vivien Sainte Fare, et al. 1[/caption] Isso mostra claramente que, para classificar corretamente as culturas, devemos fazer uso de séries temporais de dados. Dessa forma, muitos modelos de aprendizado de máquina para essa tarefa geralmente implementam arquiteturas para dados sequenciais, como transformadores. Isso torna esses modelos mais caros computacionalmente do que as redes neurais convolucionais ou totalmente conectadas tradicionais, mas fornecem resultados consideravelmente melhores.

Benchmarks atuais

Graças ao esforço de muitas organizações que trabalharam em vários benchmarks de classificação de culturas, há uma grande variedade de modelos para escolher. Um exemplo é esta implementação de Garnot et al.1 que afirma alcançar até 94,2% de precisão geral em tarefas de classificação. Embora isso seja certamente impressionante, uma desvantagem é o tempo necessário para gerar os dados de treinamento necessários. Felizmente, os autores lançaram um conjunto de pesos pré-treinados prontos para inferência, bem como o conjunto de dados de treinamento original. Com esses recursos, podemos configurar nosso próprio pipeline de classificação de culturas em pouco tempo! Realizamos nossos testes personalizados com esse modelo, usando um pequeno conjunto de dados de 500 safras. Os resultados foram bastante promissores. Não apenas obtivemos uma precisão de 94%, mas também bons valores gerais de precisão e recall para a maioria das classes: por exemplo, a pontuação de precisão para as safras de girassol e trigo duro de primavera foi de 85,7% e 98,3%, respectivamente. Por outro lado, outros tipos de culturas, como cereais, tiveram pontuações de precisão mais baixas de até 55%. Provavelmente, isso se deve ao desequilíbrio de dados em nosso conjunto de dados. Outros trabalhos promissores incluem a implementação de Transformadores de Visão para classificação de culturas por meio de séries temporais de imagens de satélite, por Michail Tarasiou e cols.2. Esse modelo também pode ser usado para segmentação de culturas, o que é uma grande vantagem. No entanto, sua precisão é um pouco mais lenta do que nosso modelo anterior, com uma pontuação de 87,1%. Como podemos ver, a classificação de culturas é, de fato, uma tarefa complexa. Mas é uma ferramenta incrivelmente poderosa. Especialmente quando combinado com nossos experimentos de segmentação anteriores.

Considerações finais

Neste blog, demos uma primeira olhada no mundo das imagens de satélite e suas aplicações na agricultura. Analisamos os dados que ele oferece e descobrimos como colocá-los em nossas mãos. Vimos seu verdadeiro potencial quando combinado com o aprendizado de máquina. E o mais importante, vimos a grande variedade de possibilidades que essas duas ferramentas podem oferecer quando combinadas e usadas em conjunto. É claro que as imagens de satélite têm muitos desafios a serem superados. Mas, graças ao aprimoramento constante dos modelos de aprendizado de máquina, podemos esperar obter melhores resultados no futuro!

Referências:

- V. S. F. Garnot, L. Landrieu, S. Giordano, N. Chehata, Classificação de séries temporais de imagens de satélite com codificadores de conjunto de pixels e autoatenção temporal, Arquivo IV: 1911.07757, 2020.

- M. Tarasiou, E. Chávez, S. Zafeiriou, VitS for SITS: séries temporais de transformadores de visão para imagens de satélite, ArXiv: 2301.04944, 2023.

- Quântico, Classificação do tipo de cultura com imagens de satélite, Medium.com, 14 de agosto de 2022.

- A. H. Khan, M. M. Fraz, M. Shahzad, Classificação da cobertura da terra e do tipo de cultura com base em aprendizado profundo: um estudo comparativo, 2021.

- R. C. Daudt, B. L. Saux, A. Boulch, Y. Gousseau, Detecção de mudanças urbanas para observação multiespectral da Terra usando redes neurais convolucionais, ArXiv: 1810.08468, 2018.

- Alexander Kirillov et al. , Segmente qualquer coisa, Meta AI Research, arXiv: 2304.02643, 2023.

- Guias do usuário - Sentinel-2 MSI - Visão geral - Sentinel Online, Sentinel Online, acessado em 10 de outubro de 2023.

- Comparação entre o Sentinel-2 e o Landsat Active, Arquivo USGS EROS, EUA Geological Survey, 1º de março de 2019.

- Explorador da Terra, Serviço Geológico dos EUA, acessado em 10 de outubro de 2023.

- Navegador Copernicus, Agência Espacial Europeia, Acessado em 5 de fevereiro de 2024

- Catálogo de imagens, INPE, Acessado em 10 de outubro de 2023.

- Desafio AgrifieldNet India, Zindi, Acessado em 10 de outubro de 2023.

- G. Sumbul, M. Charfuelan, B. Demir, V. Markl, BigEarthNet: um arquivo de referência em grande escala para compreensão de imagens de sensoriamento remoto, ArXiv: 1902.06148, 2019.

- Compósitos RGB simples (Sentinel-2), Sentinel-Hub. Acessado em 10 de outubro de 2023.

- O que é radar de abertura sintética?, Earth Science Data Systems, NASA, 10 de abril de 2020.

- O que é NDVI (Índice de Vegetação por Diferença Normalizada)?, GISGeography, 14 de julho de 2023.

- Temperatura da superfície terrestre, Serviço Terrestre Global Copernicus, 30 de março de 2023.

.png)